ChatGPT�������� ChatGPT�з�

���ߣ�chunzhi ����ʱ��:2024-03-15����ChatGPT�������ˣ�ChatGPT�з�

����3��13�գ�OpenAIͶ�ʵ����λ�����——Figure 01ӭ���ذ����£��������°�ChatGPT�����ܺ��˽���������ǰ�������������Ƶ�У�Figure �����λ����ˣ�������ȫ�����������Ի������������˵���Ȼ����ָ�����ץȡ�ͷ��ã��������Լ�Ϊʲô��ô�������䱳���� OpenAI Ϊ�����õ����ܴ��ԡ�

����Figure 01���������λ����ˣ�

���������� OpenAI ��ģ̬��ģ�͵�ǿ��֧�֣�Figure 01 ���ڿ��Ǹ�������Ʒʶ���С���֡�ƻ������ˮ�ܡ�ˮ�������ӣ�������˵����С��һ�������ˣ����������ڳԵģ������붮�����˼������ص���һ��ƻ������������һ�����㶪����������һ�߸������Ϊɶ�ղŸ�����ƻ�����������һ�����£�Figure 01 ������������ʰ�;ߣ�������ˣ���ֱ�Ǽ�ͥ�������ѻ�顣

�����ۺ�������Figure 01ӵ�е�����������

����һ���Ӿ�ʶ������⡣��������Figure 01������ʲô��Figure 01�ش����“�ҿ����������������������һ����ƻ����һ��װ�����Ӻ����ӵ�����ܣ��Լ���վ�ڸ������ַ��������ϡ�”

������������ʶ������⡣��������Figure 01�ܹ��Ե�ʲô����ʱ��Figure 01�����ϵ�ƻ���ݸ������࣬����ʾ����“Ψһ�ҿ��Դ�����Ϊ���ṩ��ʳ��”��

������������������ִ�С�Figure 01����������������������ܵij�����

���������˵��ٶ��Ѿ��ӽ������ٶ�

����Figure �Ĵ�ʼ�� Brett Adcock �� AI �Ŷӵĸ����� Corey Lynch �� X �Ͻ����˻����˻��������ԭ�����˴ε�ͻ�ƣ��� OpenAI �� Figure ��ͬ������OpenAI �ṩ�����ṩ�Ӿ��������������⣬�� Figure ���������ṩ���١���ˮƽ�����ɵĻ����˶�������������������������Ϊ���dz����Ѿ�ѧϰ�����ڻ��˵�����������������Զ�̲�����

�����о���Ա������������ͷ�е�ͼ�����룬�ͻ�����˷粶��������е��ı�ת¼���� OpenAI ѵ���ģ���������ͼ����ı��Ķ�ģ̬ģ�ͣ�VLM���У��ɸ�ģ�ʹ����Ի���������ʷ��¼���ó�������Ӧ��Ȼ��ͨ���ı��������ķ�ʽ����ظ������ࡣͬ����ģ�ͣ�Ҳ��������ڻ�������������Щѧϰ�ıջ���Ϊ����ɸ�����������ض���������Ȩ�ؼ��ص� GPU �ϲ�ִ�в��ԡ�

������Ҳ��Ϊʲô��������ˣ�����“�˵���”�Ļ����˿��ơ����������뿪ʼ��ģ�ͽӹ���һ�д�����ֱ��������Ժ���Ϊ������������м����һЩ������ټ���������������Щ�����Figure �Ļ�������ͷ�� 10hz ��Ƶ������ͼ��Ȼ���������� 200hz ��� 24 �����ɶȶ�����Figure �Ĵ�ʼ���ᵽ������������˵��ٶ��Ѿ���������ߣ���ʼ�ӽ�������ٶȡ�

�������λ����˼ӿ�“������”

����ֵ��ע����ǣ�Figure AI���ڻ������������̱�����˾ǩ����һ����ҵЭ�飬�������������в���ͨ�û����ˡ�

�������˹����ܼ����ļӳ��£����λ����˵����ܻ�ˮƽ��������������ٽ��빤������ʵ�Ĺ����������С��������֣����ж�Һ����˾���ڹ������������λ����ˣ����Ѿ���ʾ�˻�����“������”����Ƶ��

����ȥ��ף����������˹�˾AgilityRobotics���������ڶ��ո�������ķ�п��������ϵ�һ��“���λ��������칤��”�����ҳ�ŵÿ�꽫����1��̨�������λ�����“Digit”����Ϊ“������ͬ��”�ڲֿ����������Ͱ��˻������ѷ��������ͼ������һ����������Ҳ������Digit���λ����ˣ�����Э��Ա����ɲֿ��еİ��˹�����

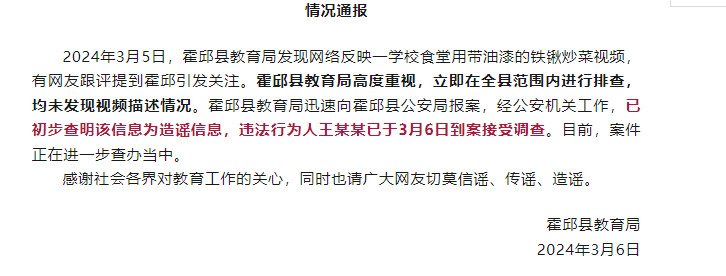

ѧУʳ���ô�������

ѧУʳ���ô������� ʲô�����ж�������

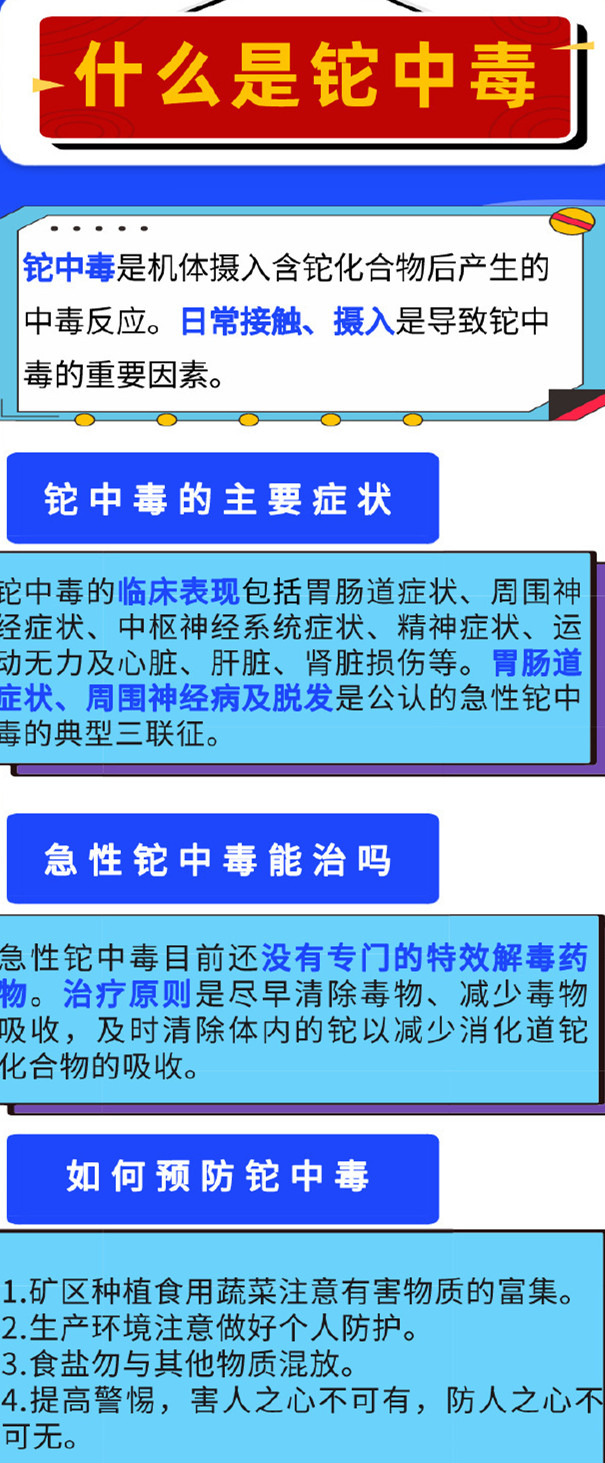

ʲô�����ж������� ��ҥ��ҹţ��������

��ҥ��ҹţ�������� Ӳ�Գ���Է��Գ���

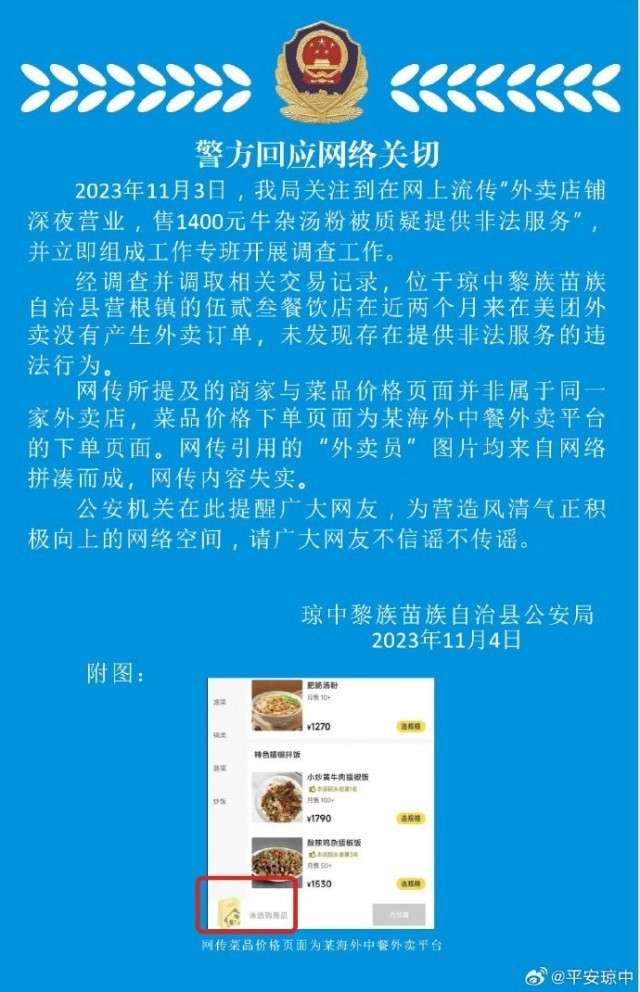

Ӳ�Գ���Է��Գ��� ��ʹ��:������������

��ʹ��:������������ ��ʹ�ݽ������Թ���

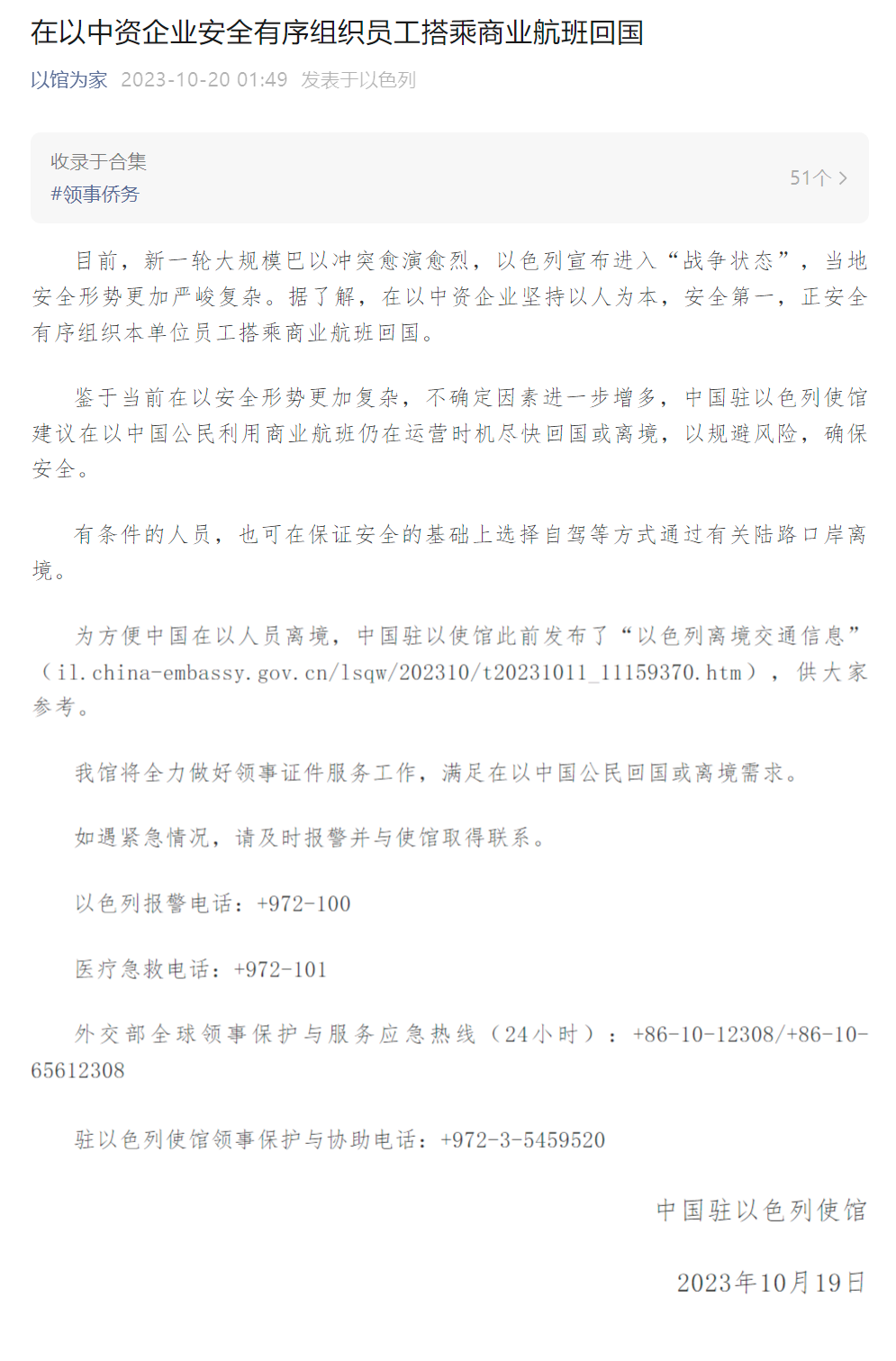

��ʹ�ݽ������Թ��� ����������������λ

����������������λ ���˴��ߵ���վ����

���˴��ߵ���վ���� ���ϴ�ѧһУ����ĸ

���ϴ�ѧһУ����ĸ �ǹܸɲ�����Ů����

�ǹܸɲ�����Ů����