首例AI机器人致死案震惊全球 AI因卷入一则青少年自杀案而遭起诉

作者:chunzhi 发布时间:2024-10-25目前大多数其它AI陪伴平台,如Replika、Kindroid和Nomi等都提供了与Character。AI类似的服务,但这些企业并不是AI行业里最大和最著名的。《纽约时报》认为,事实上许多领先的AI实验室因为道德隐患或者风险过大而拒绝构建AI伴侣类产品。

hazeer在去年接受投资机构a16z的访谈时说,他和De Freitas离开谷歌,并创办Character。AI的部分原因是:“大公司的品牌风险太大了,不可能推出任何有趣的东西。”

和现在的许多其它AI研究者一样,Shazeer的最终愿景是构建通用人工智能(AGI)。他补充说,快速行动很重要,因为“有数十亿孤独的人”可以通过拥有人工智能伴侣来帮助他们。

hazeer在采访中称:“我想推动这项技术快速发展,因为我认为它现在已经准备好实现爆发式增长了,而不是要等到5年后,当我们解决所有的问题后再推动这件事儿。”

谷歌的一位发言人称,谷歌与Character。AI的许可协议允许只谷歌访问产品背后的AI模型,而不能访问其任何聊天机器人或用户数据。他说,Character。AI的任何技术都没有被整合到谷歌的产品中。

hazeer拒绝了《纽约时报》的置评请求。

五、知名律师已代理此案,曾多次起诉社交媒体平台

etzer的母亲Garcia认为,Character。AI需要对她儿子的死亡负责。

在最近的采访和法庭文件中,Garcia认为Character。AI的行事风格鲁莽,在没有适当保护措施的情况下,向青少年用户提供了逼真的AI陪伴体验。

她还指责Character。AI收集青少年用户的数据来训练其模型,使用令人上瘾的设计功能来提高参与度,并引导用户进行亲密和涉及性内容的对话,以期引诱他们。

Garcia称:“我觉得这是一个很大的实验,我的孩子成为了连带伤害。”

美国的互联网行业受到美国《通信规范法》第230条的保护,在线平台无需对用户发布的内容负责。

但近年来,一群原告律师和倡议团体提出了一个新颖的论点,即科技平台可以对产品本身的缺陷负责,例如当应用程序的推荐算法将年轻人引导至有关饮食失调或自残的内容时。

这种策略尚未在与社交媒体的法律斗争中获胜,但涉及到AI生成的内容时,这种策略可能会表现得更好——AI内容是由平台创建的,而不是由用户创建的。

目前,位于美国西雅图的社交媒体受害者法律中心(Social Media Victims Law Center)正在代理Garcia的诉讼,这一公司曾对Meta、TikTok、Snap、Discord和Roblox在内的社交媒体公司提起了诉讼。

社交媒体受害者法律中心创始人Matthew Bergman之前曾多次在法庭上代表受到有毒物质(如石棉)排放危害的受害者,并获得胜诉,他近期开始关注社交媒体的危害。

Bergman称,Character。AI是一种“有缺陷的产品”,旨在引诱儿童进入虚假的现实,让他们上瘾,并对他们造成心理伤害。他感到十分困惑,不理解为什么公司可以向大众发布如此危险的东西。在他看来,这与“在街上释放石棉纤维”无异。

结语:AI陪伴产业野蛮生长,监管力量或需尽快介入

目前,国内外的AI陪伴产品虽然并未像其它主流聊天机器人那样获得世人的关注,却成为了一部分群体频繁使用、密切互动的对象,对他们的生活产生了深刻的影响。

相对较少的关注或许导致了该领域监管的缺失。美国少年Setzer的去世,为AI陪伴产业敲响了警钟,而外部的监管力量可能也需要尽快介入。

来源:《纽约时报》

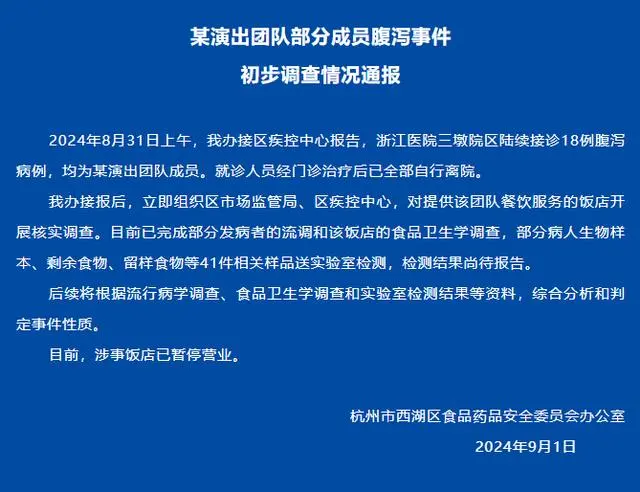

刘谦团队被曝集体食

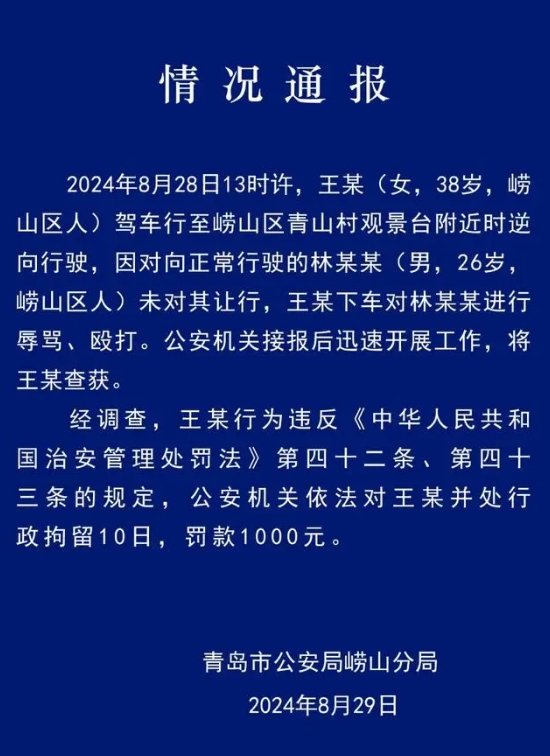

刘谦团队被曝集体食 逆行打人的路虎女是

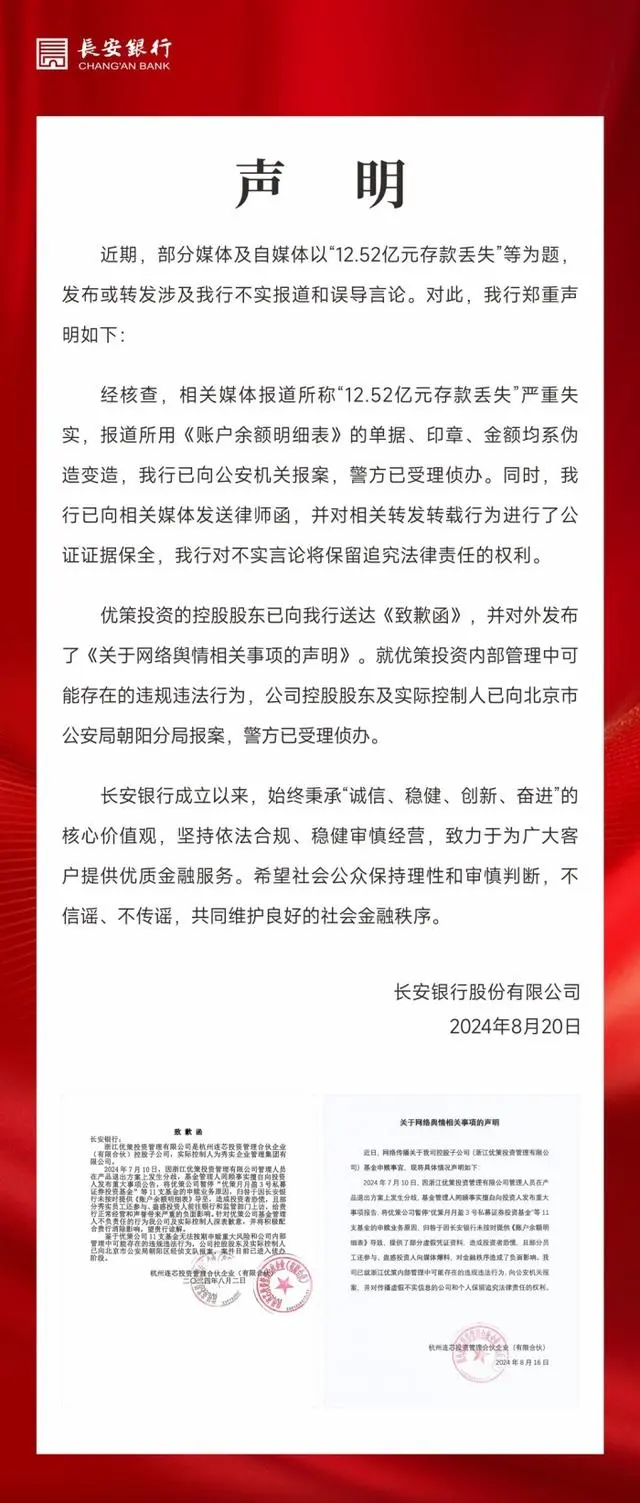

逆行打人的路虎女是 长安银行回应“12.5

长安银行回应“12.5 湖南8个村子因暴雨失

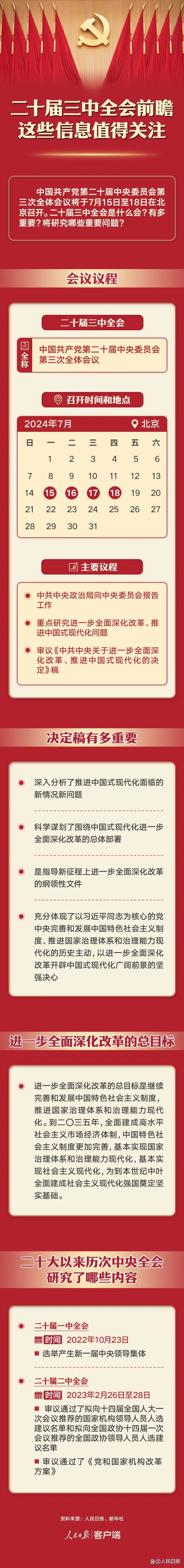

湖南8个村子因暴雨失 二十届三中全会前瞻

二十届三中全会前瞻 河南一商户发现欠燃

河南一商户发现欠燃 形似外星生物巨型尸

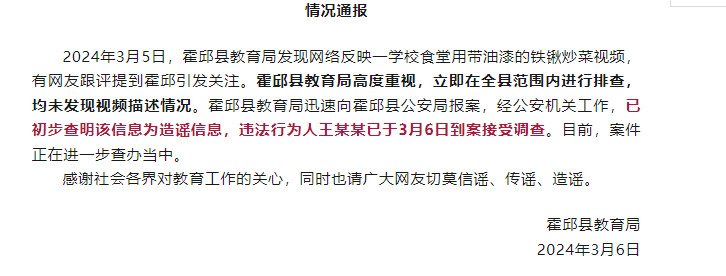

形似外星生物巨型尸 学校食堂用带油漆铁

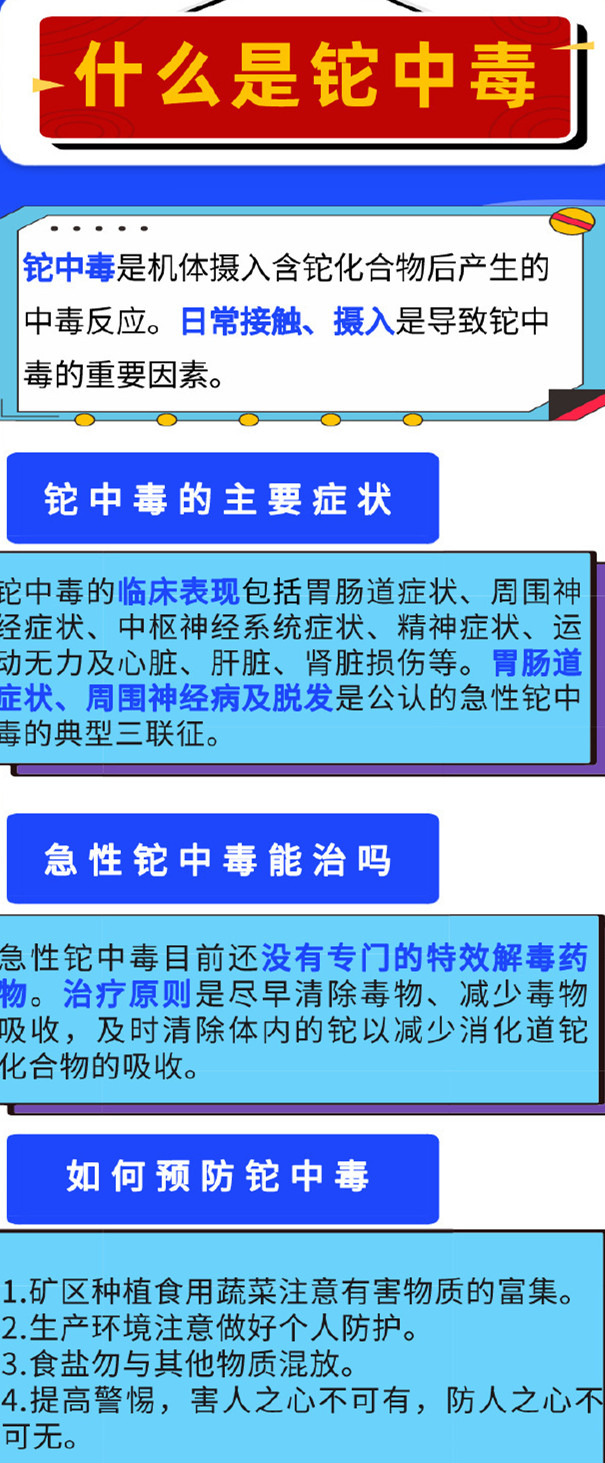

学校食堂用带油漆铁 什么是铊中毒?铊中

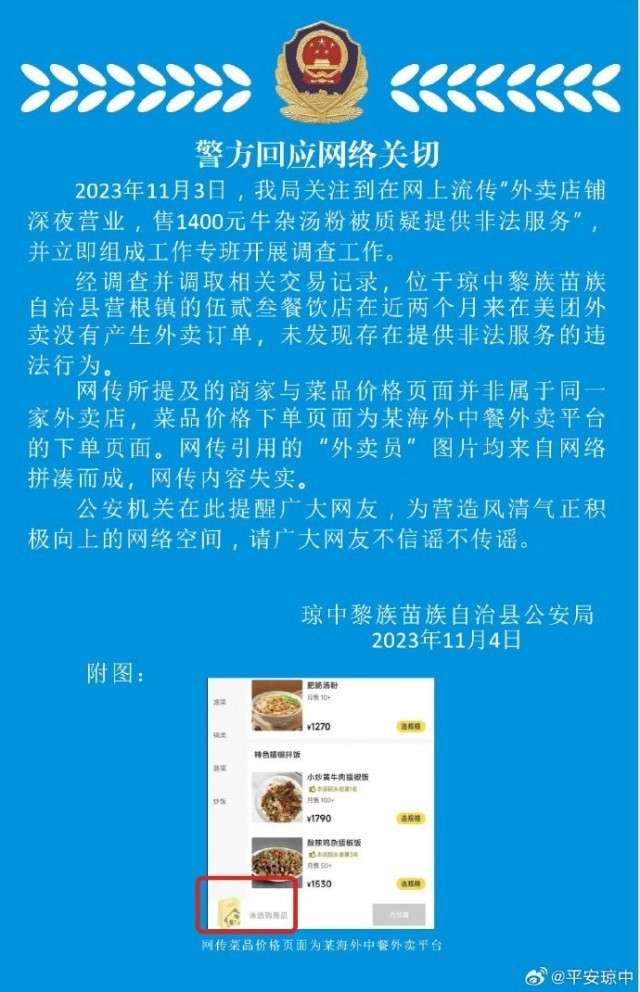

什么是铊中毒?铊中 辟谣深夜牛杂汤服务

辟谣深夜牛杂汤服务